Mối nguy lừa đảo bằng công nghệ AI Deepfake và giả mạo giọng nói người thân – Chúng ta đang sống trong thời đại công nghệ tiên tiến, nhưng đồng thời cũng phải đối mặt với những mối nguy hiểm mà công nghệ mang lại. Một trong số đó là việc lừa đảo bằng cách sử dụng công nghệ AI Deepfake và giả mạo giọng nói người thân. Trong bài viết này, chúng ta sẽ tìm hiểu về mối nguy này và cách phòng tránh.

-

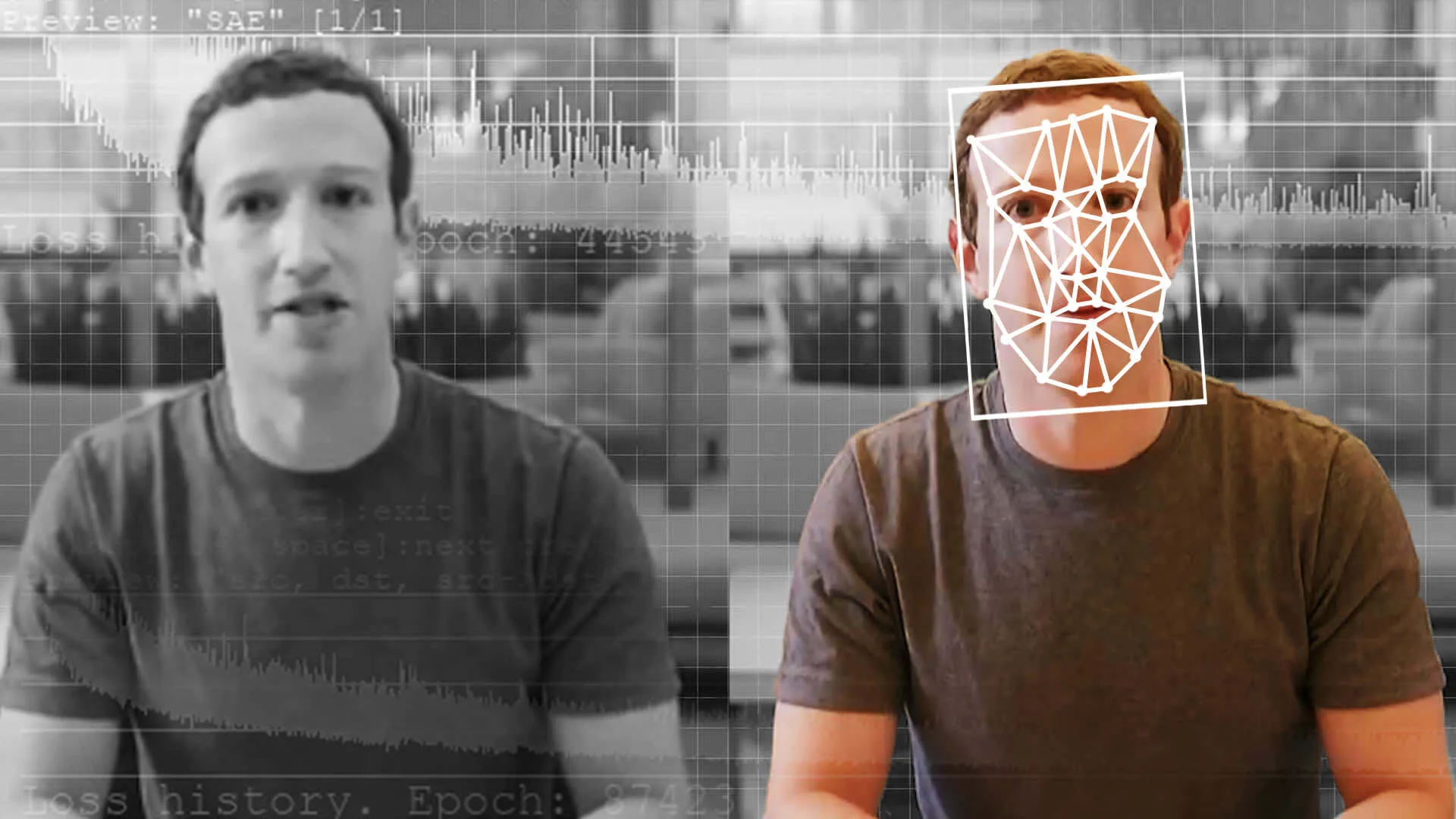

Công nghệ AI Deepfake: Sức mạnh và mối nguy của nó

Công nghệ Deepfake đã mang đến một cuộc cách mạng trong lĩnh vực trí tuệ nhân tạo. Nó cho phép chúng ta tạo ra những hình ảnh và video giả mạo với độ chân thực không thể phân biệt được với thực tế. Tuy nhiên, sức mạnh của Deepfake cũng đồng nghĩa với mối nguy hiểm tiềm ẩn đối với sự riêng tư và an ninh của chúng ta.

1.1. Lừa đảo bằng công nghệ AI DeepfakeMối đe dọa đối với cá nhân

Công nghệ Deepfake đã tạo ra khả năng giả mạo hình ảnh và video của bất kỳ ai, bất kỳ lúc nào. Điều này có thể dẫn đến những hậu quả nghiêm trọng trong việc lừa đảo thông tin cá nhân và xâm phạm danh dự của một người.

Ví dụ, một video Deepfake có thể được sử dụng để tạo ra tin đồn hoặc thông tin sai lệch về một người nổi tiếng, gây ảnh hưởng tiêu cực đến đời sống và sự nghiệp của họ. Những hình ảnh và video giả mạo cũng có thể được sử dụng để lừa đảo, gian lận hoặc tống tiền người khác. Điều này đặt ra một thách thức lớn trong việc xác định sự tin cậy của thông tin mà chúng ta nhận được từ các nguồn truyền thông.

Ngoài ra, việc sử dụng Deepfake cũng có thể gây ra các vấn đề về quyền riêng tư. Với khả năng tạo ra video giả mạo, người khác có thể sử dụng công nghệ này để xâm phạm quyền riêng tư của chúng ta. Ví dụ, hình ảnh và video giả mạo có thể được sử dụng để tạo ra nội dung nhạy cảm hoặc khiêu dâm, và sau đó được lan truyền trên mạng mà không có sự đồng ý của chủ thể trong hình ảnh.

1.2. Công nghệ AI Deepfakevà an ninh quốc gia

Ngoài mối nguy đối với cá nhân, công nghệ Deepfake cũng gây mối đe dọa đến an ninh quốc gia. Với khả năng tạo ra video giả mạo của các nhân vật chính trị hoặc lãnh đạo quân sự, Deepfake có thể được sử dụng để tạo ra thông tin sai lệch hoặc lan truyền tin đồn gây hỗn loạn trong xã hội. Điều này có thể gây ảnh hưởng đến sự ổn định chính trị và an ninh của một quốc gia.

Hơn nữa, Deepfake cũng có thể được sử dụng để thực hiện các cuộc tấn công mạng hoặc xâm nhập vào các hệ thống quan trọng. Bằng cách tạo ra hình ảnh và video giả mạo của những người có quyền truy cập vào các hệ thống này, kẻ xấu có thể lừa dối và xâm nhập vào những nơi mà họ không được phép truy cập. Điều này đặt ra một mối đe dọa lớn đối với an ninh mạng và quản lý dữ liệu.

-

Tác hại của việc giả mạo giọng nói người thân Mối nguy hiểm tiềm tàng

Việc sử dụng công nghệ Deepfake không chỉ cho phép chúng ta giả mạo hình ảnh và video, mà còn có thể giả mạo giọng nói của người khác. Điều này tạo ra một mối nguy hiểm tiềm tàng đáng lo ngại. Bởi vì giọng nói của một người thân có thể bị lợi dụng để gian lận hoặc lừa đảo. Ví dụ, một kẻ gian có thể sử dụng giọng nói của bạn để yêu cầu chuyển khoản tiền hoặc thực hiện những hành động không đúng đắn.

Công nghệ Deepfake đã phát triển đáng kinh ngạc và cho phép việc ghép đồng bộ giọng nói với hình ảnh của một người khác. Điều này có thể tạo ra những video hay băng ghi âm giả mạo một cách chân thực, khiến người nghe hoặc xem tin tưởng rằng đó là giọng nói thật của người thân.

Việc giả mạo giọng nói người thân có thể có những hậu quả nghiêm trọng. Một trường hợp tiêu biểu là việc lừa đảo tài sản. Kẻ gian có thể sử dụng giọng nói của bạn để yêu cầu người thân hoặc đồng nghiệp chuyển tiền tới tài khoản của họ. Bằng cách giả mạo giọng nói của bạn, chúng có thể tạo ra một tình huống khẩn cấp và ép buộc người khác thực hiện những hành động không mong muốn. Điều này có thể gây ra những thiệt hại tài chính và cá nhân không thể lường trước.

Ngoài ra, việc giả mạo giọng nói người thân cũng có thể được sử dụng để gian lận trong lĩnh vực pháp lý và xã hội. Ví dụ, một người có thể sử dụng giọng nói giả của người khác để đưa ra lời khai giả mạo trong phiên tòa hoặc để tạo ra những thông điệp gian lận trên mạng xã hội. Điều này gây ra sự mất đáng tin cậy và ảnh hưởng đến quá trình xác minh thông tin trong các vụ án.

-

Cách phòng tránh mối nguy lừa đảo

Để đối phó với mối nguy lừa đảo bằng công nghệ AI Deepfake và giả mạo giọng nói người thân, chúng ta cần những biện pháp phòng ngừa hiệu quả. Dưới đây là một số gợi ý giúp bảo vệ bản thân và ngăn chặn việc sử dụng giọng nói của người thân một cách trái phép

3.1. Giữ bảo mật thông tin cá nhân

Để tránh việc thông tin cá nhân của bạn bị lợi dụng, hãy cẩn thận khi chia sẻ thông tin cá nhân trên mạng xã hội hoặc các nền tảng trực tuyến khác. Hãy đảm bảo rằng chỉ những người tin cậy mới có thể truy cập vào thông tin cá nhân của bạn.

3.2. Kiểm tra nguồn tin

Trước khi tin tưởng vào một tin tức hoặc thông tin, hãy kiểm tra nguồn tin để đảm bảo tính xác thực. Luôn luôn xác minh thông tin từ các nguồn đáng tin cậy và tránh tin tưởng vào thông tin không rõ nguồn gốc.

3.3. Sử dụng các công cụ phát hiện Deepfake

Có nhiều công cụ và phần mềm phát hiện Deepfake hiện có trên thị trường. Hãy sử dụng chúng để kiểm tra xem một hình ảnh hoặc video có phải là Deepfake hay không. Nhớ rằng việc sử dụng công cụ này chỉ là một biện pháp hỗ trợ và không đảm bảo 100% khả năng phát hiện.

3.4. Giữ liên lạc thường xuyên với người thân

Để tránh bị lừa đảo bằng giọng nói của người thân, hãy duy trì liên lạc thường xuyên và xác minh thông tin trực tiếp từ họ. Hãy thảo luận với người thân về những biện pháp bảo mật mà cả hai có thể thực hiện để đảm bảo an toàn thông tin và tránh bị lừa đảo.

-

Kết luận

Mối nguy lừa đảo bằng công nghệ AI Deepfake và giả mạo giọng nói người thân là một thách thức đáng gờm trong thời đại công nghệ hiện nay. Để bảo vệ bản thân và người thân, chúng ta cần phải tỉnh táo và áp dụng những biện pháp phòng ngừa hiệu quả. Hãy nhớ rằng sự cảnh giác và sự hiểu biết về công nghệ là điều quan trọng để đối mặt với mối nguy này.

Xem thêm: Lợi ích đơn giản nhưng hữu ích của trí tuệ nhân tạo AI trong cuộc sống, Bí quyết làm giàu online

Tin cùng chuyên mục:

Tìm kiếm sự cân bằng cuộc sống trong thời đại thông tin bùng nổ

Thị trường giải trí trực tuyến tại Việt Nam: Cơ hội và thách thức cho các nhà sản xuất nội dung

Sức mạnh của cộng đồng mạng trong việc lan tỏa thông tin và kiến thức

Sách điện tử và thói quen đọc của người Việt trong kỷ nguyên số